ハルシネーション(AI幻覚)とは? AIが嘘をつく理由と対策を解説

ChatGPTが架空の判例を引用した、AIが存在しない論文を紹介した――こうした報道を目にしたことがあるかもしれません。AIがもっともらしいが事実と異なる情報を生成する現象を「ハルシネーション(幻覚)」と呼びます。AI活用において最も注意すべきリスクのひとつです。

ハルシネーションとは ― ひと言でいうと

ハルシネーション(Hallucination)とは、AIが事実に基づかない情報を、あたかも事実であるかのように自信を持って生成してしまう現象です。「AIの幻覚」とも訳されます。

厄介なのは、AIの出力が文法的に正しく、論理的にもつながっているため、一見すると正確な情報に見えてしまう点です。専門知識がなければ、ハルシネーションを見抜くのは困難です。

なぜハルシネーションが起きるのか

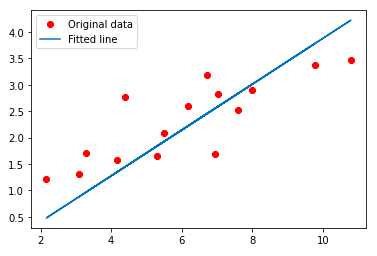

LLMの基本的な仕組みは「次に来る確率の高い言葉を予測する」ことです。つまり、LLMは「事実を調べて回答する」のではなく、「それらしい言葉を並べる」ことで文章を生成しています。この仕組み上、事実とは異なる内容でも、文脈として自然であれば出力してしまうのです。

また、学習データに含まれていない情報や、学習データの中で矛盾する情報がある場合にも、ハルシネーションが生じやすくなります。

ビジネスでのリスクと対策

ハルシネーションは、AIの出力をそのまま公開・利用した場合に深刻な問題を引き起こし得ます。誤った情報の発信による信頼低下、法的リスク、意思決定の誤りなどが考えられます。

対策としては、まずAIの出力を必ず人間が確認するチェック体制を設けることが基本です。さらに、RAG(検索拡張生成)を導入して自社のデータベースや信頼できる情報源を参照させることで、ハルシネーションの発生を大幅に抑制できます。AIに「わからないことはわからないと答えて」と指示するプロンプト設計も有効です。

まとめ

ハルシネーションは「AIがもっともらしい嘘を生成する現象」です。完全にゼロにすることは現時点では難しいため、「AIの出力は必ず確認する」という前提で運用することが重要です。エクスチュアでは、ハルシネーション対策を含めたAI導入の設計を支援しています。